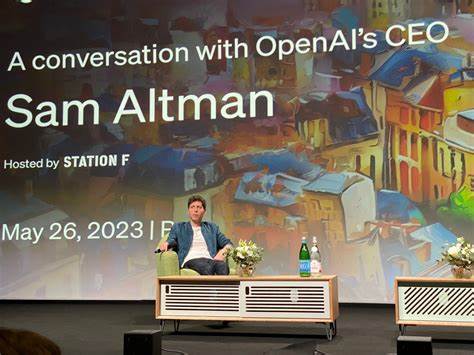

随着人工智能技术的飞速进步,越来越多的人开始将ChatGPT等AI工具用于日常生活中的各种需求,其中包括心理咨询和情感支持。然而,OpenAI的首席执行官萨姆·奥特曼近日在一次重要采访中发出警示:目前,使用ChatGPT这类人工智能进行心理治疗或类似服务时,并没有法律上的保密保障。用户的对话内容可能无法享受与传统医生、律师或心理治疗师之间的法律保密权利,这一现实带来了深刻的隐私和法律问题。萨姆·奥特曼的警告不仅揭示了当前AI技术伦理和法律监管的缺失,也折射出用户在数字时代保护自身隐私的复杂挑战。首先,需要理解的是,传统的医生-患者关系中所享有的保密权利,是一种法律赋予的重要保护机制。无论是在心理治疗还是医疗诊断中,患者所透露的个人信息和隐私受法律严格保护,这些信息不得随意披露,确保患者在寻求帮助时能够放心坦诚。

然而,当人工智能代替人类专业人士提供类似服务时,现行法律尚未建立相应的隐私保护框架。萨姆·奥特曼坦言,OpenAI和整个AI行业正在面对一个未解的隐私难题。用户在与ChatGPT交流最私密的情感、心理和法律问题时,这些对话内容实际上可能被存储、分析,甚至在法律诉讼中被作为证据调取。这意味着,用户若将AI视为心理治疗师,放心倾诉内心困扰,很可能在毫不知情的情况下,失去了法律赋予的隐私保护。更令人担忧的是,OpenAI目前已处于法律诉讼之中,法院曾下达命令要求其保存数亿用户的聊天记录,这显示出技术公司在法律面前承受的巨大压力。如果法律允许强制要求提供用户数据,未来可能出现更多类似情况,加剧用户隐私的暴露风险。

面对这一现状,萨姆·奥特曼表示应当尽快建立起AI领域的法律和政策框架,使得用户与人工智能的交流能够获得和传统医疗、法律咨询同等的隐私保护。他强调,没有隐私保障将阻碍公共对AI应用的广泛接受和信任发展。很多年轻用户乐于用ChatGPT当作生活教练或者情绪倾诉的对象,这反映了社会对于心理健康服务的巨大的需求与不足。然而,缺乏保密性的风险可能使他们面临隐私泄露,甚至不利的法律后果,尤其是在申请法律援助或者涉及社会敏感问题时。更广泛地看,这一问题暴露了AI技术发展与法律监管之间的脱节。人工智能在数据采集、处理和应用方面极大地依赖于大量用户数据,而这些数据往往包含极为敏感的个人信息。

如何在推动技术创新的同时,保护用户隐私权利,成为摆在立法者、技术开发者以及公众面前的共同难题。值得注意的是,随着诸多国家和地区隐私保护法规的完善,例如欧洲的GDPR(通用数据保护条例)和加州的CCPA(加州消费者隐私法案),用户对隐私的保护意识日益增强。相比之下,人工智能领域的专门法规仍显不足,这使得技术企业在用户数据的保存和使用上面临法规真空,进而引发法律诉讼和社会争议。从消费者角度看,目前多数用户并未完全意识到自己在使用AI服务时所面临的隐私风险。部分用户可能将ChatGPT等工具视为随时可用的情感支持渠道,但缺乏法律保密使得这些私密话题可能被搜索查询、广告定向甚至司法调查利用。萨姆·奥特曼的呼吁旨在提醒公众慎重使用AI工具作为心理或法律咨询资源,同时推动行业和监管机构加大努力,搭建完整的隐私保护体系。

此外,随着隐私权问题日益重要,技术公司开始探索采用更先进的数据加密和匿名技术,试图保护用户对话内容的机密性。ChatGPT企业版就被排除在部分法律诉讼要求之外,以保护商业用户的数据安全。未来,如何实现人工智能与隐私保护的平衡,将成为决定AI技术能否深入人类生活各个层面的关键。展望未来,监管机构需与技术企业深度协作,制定针对AI服务的隐私保护标准,涵盖数据采集、存储、处理和法律合规等各个环节。法律体系也须更新以适应AI介入人们隐私领域的现实,为用户提供清晰的权利保障和纠纷解决渠道。公众在享受AI带来的便利同时,也应增强对隐私保护和数据安全的认识,合理评估使用AI作为心理治疗帮助的利弊,避免将最敏感的信息暴露于可能缺乏充分保护的环境中。

总之,萨姆·奥特曼的警告为我们敲响了隐私保护的警钟。在人工智能日益成为人们生活不可或缺的一部分的时代,只有法律、技术和社会共同努力,才能确保用户的个人信息安全与隐私权利得到应有的尊重和保护。否则,AI技术带来的便利可能被隐私风险所抵消,影响用户信任和行业的未来发展。随着社会对心理健康需求的日益增长,如何利用人工智能优质资源提升公共健康服务,又不牺牲隐私安全,将成为一项艰巨但必须完成的任务。期待不久的将来,AI行业能够实现对用户最敏感对话的法律保密,使每个人都能安心、放心地使用AI技术改善生活质量。