近年来,生成式AI工具如ChatGPT、Copilot和各种自动化写作与设计平台,正以惊人的速度进入职场。它们表面上能快速产出格式完美、排版优雅的文档和邮件,但在许多组织中,越来越多的员工开始遭遇一种新的负担:看似完成了工作的AI生成产物,其实在深层上缺乏实质价值、存在错误或不符合组织标准。研究者为这种现象提出了一个形象化的名称 - - workslop。workslop既不是传统意义上的懒散,也不同于彻头彻尾的错误创作,它是一种"伪完成":看起来尽责,实际上需要他人花大量时间去清理和校正。理解workslop的成因与影响,是企业在拥抱AI时必须面对的重要课题。 学术与行业研究提供了清晰的警示信号。

斯坦福社交媒体实验室联合职业培训机构的研究通过对1150名桌面工作者的调查发现,约40%的受访者曾收到疑似由AI生成的低质量工作内容,平均每次要花近两小时去整理或修正。这种隐形的"清理成本"不仅吞噬了个人时间,也侵蚀了团队信任与协作效率。与此同时,麻省理工媒体实验室的一份报告指出,多数AI试点项目并未带来可衡量的成本节省或利润提升,表明工具本身并非灵丹妙药,应用方式与管理设计才是决定性因素。将这些数据放在一起,清晰可见:当AI被错误使用或缺乏必要监督时,它会制造更多工作而非减少工作。 workslop常见于几类任务。营销团队会收到外观精美但缺乏品牌调性和事实核查的邮件草稿;产品团队会收到格式良好的功能说明书,却遗漏关键实现细节或错误引用数据;软件团队会看到由自动补全生成的代码片段,这些代码能通过语法检查但包含隐蔽漏洞或逻辑缺陷;风投资本和销售团队会收到千篇一律、似曾相识的冷邮件,难以判断创始人真实能力与项目差异。

更糟的是,这类产出落在团队内部以后,会让本应承担核心职责的员工把时间花在清理这些伪成果上,导致组织关键能力退化。 信任的损耗往往是最难弥补的后果之一。工作协作建立在对同事能力与责任心的预期之上。当一位同事将未经充分编辑的AI输出推给团队,接收方会感到被动接过另一项"未完成的任务",久而久之会怀疑该同事的可靠性,甚至怀疑整个团队的工作标准。这种情绪损耗对跨部门合作和创新氛围极为不利。另一方面,当外部合作伙伴或客户感知到大量模板化、空洞的内容时,他们对公司的专业性和判断力也会打折扣。

研究显示,接收者如果怀疑消息由AI生成,往往会对发送者的评价更加负面,这在客户沟通和人才招聘场景中尤为致命。 在技术层面,AI带来的效率错觉也值得警惕。以编程为例,一些企业在使用自动补全工具后确实看到代码量增加,但错误率也随之上升。企业内对GitHub Copilot等工具的评估显示,使用者并未显著降低工作时间或疲劳,但出现的错误率明显上升,导致更多时间投入到代码审核与调试上。这种"把时间从写代码转移到审查代码"的现象,被称为vibe coding或AI清理工作,说明AI改变了工作内容的性质而非总量。 面对workslop,企业和个体需要从文化、流程与技术三个层面同时应对。

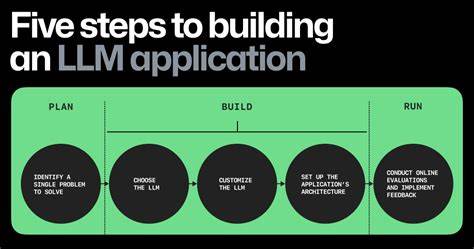

首先,明确价值与使用场景是基础工作。组织应讨论并定义哪些任务适合用生成式AI辅助,哪些任务必须由人类主导。从创意初稿到最终交付,中间哪些环节可以接受AI生成的草稿,哪些环节必须有人工审核和签字,需由管理层和业务团队共同制定清晰标准。其次,建立质量门槛和验收标准极其重要。为常见的可疑输出类型制定核查清单和验收测试,例如邮件需符合公司语气与合规要求,技术文档需通过事实核查与可复现测试,代码需通过单元测试与安全检查。将这些标准嵌入日常工作流,可以避免将"清理"变成隐性劳动。

训练与能力建设也不可或缺。人们往往低估了有效提示工程与后期编辑的技能门槛。熟练的提示工程师能把AI产出变成高质量草稿,而不熟练的输入往往导致误导性或空洞的输出。企业应当投资于员工在提示撰写、输出审查和事实核验方面的培训,帮助团队掌握如何与生成式AI协作而不是被其替代。与此同时,招聘策略也应与时俱进。市场上对精通AI工具但同时具备专业判断能力的人才需求上升,企业应优先考虑那些能够在AI产出上进行有效把关的候选人。

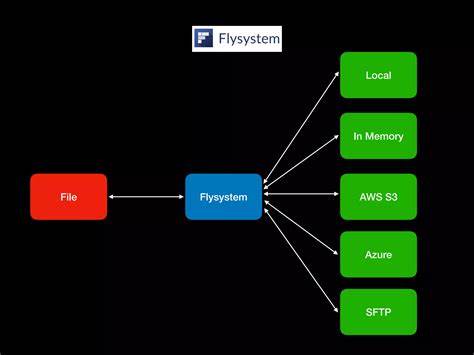

治理与合规机制能够把随机的试错转化为可管理的改进。组织应建立AI使用政策,明确允许的工具、敏感数据的处理规则以及违规后果。在敏感场景下启用审计日志和版本控制,确保每一次AI生成的输出都可以追溯并由责任人签字确认。对于客户沟通和公共发布类内容,建议设置多级审核机制,并保留人工最终签发的环节,以防范branding失误或法律风险。技术上可引入自动化的检测工具来标注可能由AI生成的文本、检测事实错误或风格偏差,作为人工复核的第一道筛选线。 衡量与反馈是治理闭环的核心。

企业应建立针对AI辅助工作的KPI,包括编辑时间、错误率、客户满意度和项目重工率等指标,通过数据来判断AI工具是否真正带来价值。若发现AI引发的清理成本长期高于节省的时间,就需要重审工具选择与使用方式。同时,鼓励员工提供匿名反馈,帮助管理层识别哪些AI应用场景产生了负面外部性,并以此优化政策和培训。 对于个体工作者,有几条实操性建议可以立刻采用。首先在使用AI产出时要有责任感:把AI视作草稿生成器而非最终作者,始终进行事实核查和风格润色。其次在团队内部明确交付物的完备定义,当把AI产出交给同事之前,按照既定验收清单先行自检,减少他人"二次劳动"。

再次对外沟通尽量保持个性化与诚意,避免全套模板化信息,尤其是在冷邮件和首次沟通时,更需要投入时间去针对对象定制内容。最后保持学习心态,提升提示设计、内容编辑和技术审核等技能,成为AI时代不可或缺的"监督者"。 组织文化的塑造同样关键。领导者要通过示范与激励,传递对质量与负责任使用AI的重视。奖励那些能将AI产出打磨成高质量交付的员工,而不是单纯奖励交付速度。鼓励团队共享有效的提示模板与审核流程,形成跨部门的知识库,避免重复犯错。

建立透明的错误处置流程,容许在没有恶意情形下的试错,但要求有修正和学习的机制,从而把分散的混乱转化为组织能力的提升。 从更广阔的视角看,workslop反映的是技术变革与组织适配之间的不匹配。历史上每一次生产工具的进步都会在短期内改变劳动的内容与分工,关键在于社会和企业能否迅速调整制度与技能结构。生成式AI的价值并非天然、自发地体现,而需要通过培训、治理和文化建设逐步释放。那些把人类判断、专业知识和价值观置于AI之上的组织,才可能真正把技术带来的效率红利转化为长期竞争力。 结语在于平衡。

生成式AI提供了前所未有的生产力工具,但如果缺乏必要的监督与标准,它也会制造大量workslop,让人们在看似更忙碌的表象下实际更低效。通过明确使用场景、强化人工在环节中的角色、建立质量门槛与审计机制,以及投资员工能力建设,企业可以把AI从"问题制造者"变成"问题解决者"。最终目标不是简单地替代人类劳动,而是重塑工作方式,让AI在释放重复性任务的同时,提升人类在判断、创造与协作上的价值。只有把好工具用到真正需要的地方,组织才能避免陷入"花哨却无用"的泥潭,迎来真正有价值的智能化变革。 。