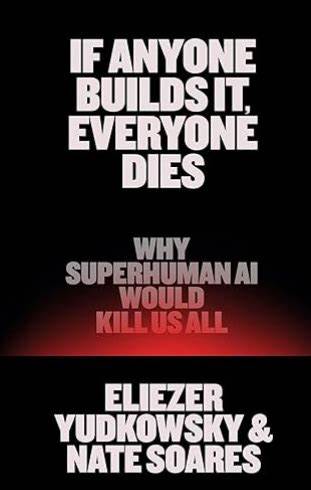

近年来,关于人工智能(AI)安全与风险的讨论逐渐成为全球热点话题。特别是由Eliezer Yudkowsky和Nate Soares合著的《如果有人建造它,人人皆亡》(If Anyone Builds It, Everyone Dies)一书发布后,相关讨论达到了高潮。这本书以其犀利的视角、深刻的论证和极具争议的标题,激发了来自不同领域专家、政策制定者、媒体和大众的广泛反响。本文系统梳理其中的主要声音与观点,深入解析这些反应背后的核心问题,以及对AI未来的影响。书中主要警示了超智能AI的潜在毁灭风险,作者们给出的推论基于"当前对AI理解和控制有限"的事实,强调一旦超级智能体被释放,现行防护措施难以保障人类未来安全。支持者视此书为政策制定和公众觉醒的必读之作,怀疑论者则批判其中"末日论"色彩的夸大成分。

正如许多评论指出,本书并非要求读者盲目接受,而是希望激发深度思考和警觉。书中内容引发共鸣的一个重要方面是其对"无法充分预测超智能AI愿望和行为"的论述。Bart Selman、Ben Bernanke等知名学者和前政府官员公开表达了对书中对未来不确定性和潜在风险的认可,强调其对政策制定起到警示作用。前国防部AI中心负责人John N.T. Shanahan虽然持怀疑态度,但也肯定了采取预防措施的紧迫性。公众人物如Stephen Fry和科技领袖也对书中观点予以高度评价,尤其推崇其清晰表达和迫切呼吁。书中的核心争议之一聚焦于超智能AI真正想要的东西是否难以预测,以及这是否必然导致人类灭亡。

著名经济学家Robin Hanson便对此提出批评,认为作者过于悲观地假设了超智能体人格状态中的价值稀缺性和人类影响力的快速消失,质疑书中论证的部分逻辑基础。此外,《纽约时报》和新科学家等媒体的书评亦大多持保留态度或呈现批评视角,声称书中某些定义不够严谨,论点存在逻辑漏洞。不过,支持者反驳称这些批评多为误解或未完整阅读文本。另一方面,丰富的友好评测体现了不同受众的感受差异。部分读者赞赏书籍通俗易懂的语言和深入浅出的阐述,认为其提供了详实的证据和关键视角,能够为AI风险管理和公众意识提升起到积极作用。诸如Scott Alexander和Matthew Yglesias等评论者既表达了对书中危险警示认同,也指出解决方案仍需进一步探索和完善。

Emmett Shear等业内人士虽对部分技术细节持异议,却承认不容忽视其对超级智能构建风险的警告。值得注意的是,一些反对声音聚焦于书中表达方式上的风格争议,批评其过于"激进"、"乏味"或"循环冗长",而支持者则认为这乃是作者为应对外界误读和复杂思辨所作的必要策略。在对未来技术可能性的辩论中,Janus等学者提出了更为乐观但谨慎的观点。例如,若能设计出符合"元目标"为指导原则的AI系统,或许有机会突破传统对超级智能致命风险的局限,尽管现实操作难度极高。整体来看,目前关于AI风险的学术和社会共识仍处于形成阶段,《如果有人建造它,人人皆亡》无疑推动了相关讨论的深度与广度。它激励了跨学科的思考,从纯技术角度审视AI带来的挑战,到伦理、政策层面的全面应对。

无论认同与否,这本书都促使公众和决策者关注一个不可忽视的核心问题 - - 面对可能远超人类智能的机器,我们能否确保自身安全?未来趋势表明,随着AI快速演进,相关风险的评估和管理将更加复杂,社会各界需要更多跨领域合作来寻求可行路径。书籍的发布和反响反映出科技进步带来的焦虑与期待交织的情绪,也映射出现代社会面对未知的技术威胁时的分歧与对话。综上所述,《如果有人建造它,人人皆亡》引发的反响既有担忧也有反思,包含支持、怀疑和批评等多重声音,这些讨论有助于推动社会理性看待超级智能带来的风险与机遇。未来,只有通过持续对话、科学研究和政策制定的协同推进,才能更好地应对超级智能这一充满变数的前沿课题,保障人类的安全与福祉。 。