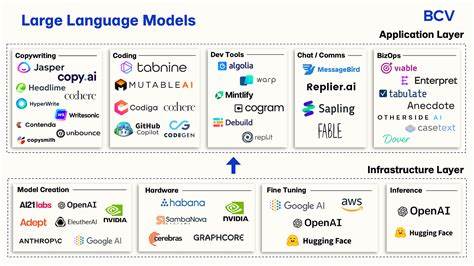

随着人工智能技术的飞速发展,大型语言模型(LLM)如ChatGPT和其他先进的语言生成系统逐渐成为科技界和社会的焦点。无论是在日常写作、内容生成还是问题解决方面,LLM展现出前所未有的便利和效率。然而,围绕这些模型是否具备“创造力”以及“推理能力”的争论却愈演愈烈。本文旨在透视LLM所谓“推理”和“创新”的本质,指出晦涩来源的剽窃绝非真正的创造力,呼吁整个行业保持清醒的认知与谨慎的态度。首先,需要明确的是创造力的核心——它不单是对已有知识的重组,更重要的是提出前所未有、新颖且具备独创性的想法。对于人类来说,创造力体现在打破常规思维、构建新理论或者解决历史从未遇到的问题。

相比之下,当前的大型语言模型主要通过海量训练数据中的模式识别和信息组合来生成文本。它们所展现的“推理”更像是基于统计概率对已有知识的重塑,而非自主思考或真正意义上的创新。许多业内人士,甚至部分权威机构,强调这些模型正在迈向具备推理和创造力的“通用人工智能(AGI)”。然而,经过深思熟虑可以发现,这一观点存在根本性的问题。将LLM不能自我创新的能力误读为推理,是对科技进步的误导,也是对投资者和普通用户的过度期待。现代大型语言模型无疑在信息整合和文本生成方面表现卓越,但其输出大多源于对训练数据中的语料进行复杂计算和匹配,其本质是“晦涩来源的剽窃”,即利用那些不为大众广泛熟知的内容信息进行再加工,以营造新颖的表象。

虽然表现出令人惊叹的语言流畅度和逻辑连贯性,但未曾真正突破已有知识框架,也未能产生根本性的创新思想。换言之,LLM由训练数据决定了它的局限性,无法跳脱已有的数据海洋独立思考。真正的推理和创造需要超越数据驱动反应的范畴,要求生成前所未有、没有先例的解决方案或理念,而目前尚无任何证据表明现有的语言模型能够达到这一标准。一个有效的验证标准便是让这些模型尝试解决历史上从未被提出过的实际问题,并以全新视角提出可行方案。至今,没有任何一家模型或公司能在这方面取得突破。这也进一步印证了“晦涩来源剽窃不是创造力”的观点。

许多公司为了吸引资本和媒体关注,不惜夸大语言模型的能力,渲染其即将实现“智慧爆炸”甚至AGI的美好愿景。然而科学和技术发展绝非仅靠营销就能推动,夸大其词有损整个行业的健康发展,并可能导致资源错配,妨碍真正基础研究的进步。不可否认的是,LLM在文本生成、辅助写作、知识整理等方面的应用极具价值。它们推动了工作效率的提升,也为研究和教育带来了便利。然而,我们必须理性看待它们的能力,避免盲目赋予其超出现实的期待。创造力是人类智慧的象征,非仅仅依赖对历史数据的拼凑所能替代。

以批判和求证的态度面对AI的发展,是确保技术进步真正服务于人类社会的必要条件。作为用户与开发者,我们都应要求行业领头羊提供更加透明和科学的证据,证明其所谓“推理”能力的真实性,而非仅依赖模型表现出来的华丽结果。只有这样,才能避免科技发展过程中失控的泡沫和虚幻繁荣。未来的进步仍有巨大的潜力等待挖掘,但必须基于扎实的科学探索和诚实的技术揭示。晦涩来源剽窃可能能够满足一时的文本生成需求,但绝不可能替代真正的创造力。真正推动人工智能迈向新纪元的,是人类对知识和思维本质的深入理解和突破;而非单纯依赖历史信息的机械回放。

愿业界同仁携手合作,秉持谦虚谨慎的科学精神,共同迈向智能科技更加光明且可持续的未来。