在当今数字化浪潮的推动下,预测技术已经无处不在,深刻影响着社会的方方面面。从我们每日的消费选择到信息获取,再到社交互动,算法几乎主导了我们的生活节奏和决策方式。然而,这种由算法驱动的现实并非仅仅是科技进步所带来的便利,更藏匿着对个体自主性以及自由民主制度的潜在威胁。理解"成为算法问题"这一概念,有助于我们反思人与技术之间的关系,并寻找维护人类探索精神的有效路径。 "成为算法问题"这一说法形象地描绘了当个体的行为模式在算法视角下成为难以归类或预测时所面临的困境。在算法主导的数据驱动社会中,预测技术依赖于对用户行为的归纳与分类,以便提供更精准的服务和广告投放。

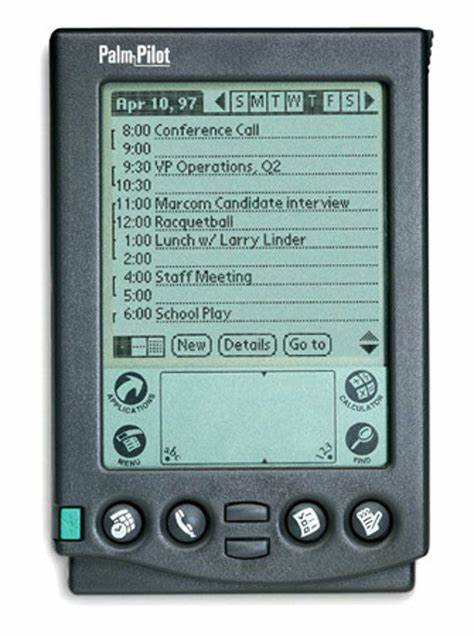

用户的习惯越是符合预设模式,算法就越能有效地进行"利用",不断加深对用户偏好的理解。然而,过度的模式化行为却导致探索变得稀缺,使得个体陷入一种"利用"(exploitation)而非"探索"(exploration)的循环之中。 从强化学习的角度看,智能系统必须在探索未知与利用已知之间取得平衡。过分依赖已知信息,会使系统失去应对新情况的灵活性;反之,过多探索则导致效率下降。然而,在商业驱动的算法设计中,企业更倾向于削弱个体的探索行为,因为不确定性和多样性会增大其分类及营销的难度。于是,用户过度依赖熟悉的内容和推荐,舍弃了对新领域、新观点的尝试,逐渐丧失了开放包容的心态。

这种算法的行为导向不仅影响用户个人的认知空间,更逐渐侵蚀了自由民主的基础。民主社会依赖于公民的批判性思维和开放的讨论氛围,只有通过不断的质疑和反思,才能推动社会的进步与多元共存。算法造成的信息茧房效应加强了认知同温层,削弱了不同观点之间的交流,使得社会极易陷入极端化及分裂。久而久之,个体的社会行为被渐渐规整,成为技术可控的"可预测人群",而难以发挥创新和变革的潜力。 此外,从国家治理视角出发,算法提供了前所未有的社会监管能力。正如政治学家詹姆斯·C·斯科特所指出,现代国家追求使国民"可读懂",以便更好地施政和控制。

过去由于技术限制,统治者难以全面理解居民的生活细节,而如今借助大数据和预测模型,每个人的行为轨迹几乎都被记录和分析。如此精细的社会监控极大提升了治理效率,但同时也削弱了隐私权和个人空间,使人们在无形中丧失了探索未知和反抗规范的自由。 面对技术与权力合力构筑的这一现实挑战,社会必须重新审视人类与算法之间的"社会契约"。在这个契约中,人们为了逃避选择的疲劳,交出了一定的自主权以换取便利的数字生活。然而,这是否意味着我们应该甘愿沦为仅被算法定义和支配的"算法问题"呢?答案显然是否定的。透过批判的视角,我们意识到,只有保留并激发个人和集体的探索精神,才能维护社会的多样性和民主的活力。

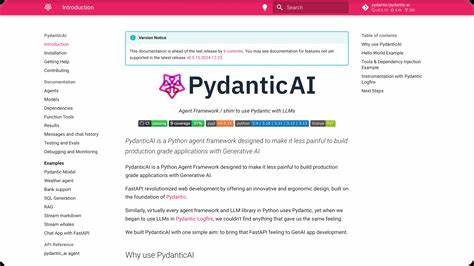

要达到这一目标,既需要技术层面的调整,也需要文化意识的革新。算法设计者应当构建能够平衡推荐与探索的系统,使用户在享受个性化服务的同时,仍能接触多元且新颖的信息内容。政府和社会组织也应加强数字素养教育,培养公众对算法机制的理解和批判能力,提高对信息来源的辨识力。更重要的是,公众应主动承担起抵抗被算法限制的责任,勇于打破信息的局限,追求广泛的知识和经验。 从制度上讲,政策制定者需要推动透明且负责任的算法治理。规定企业公开算法规则,加大隐私保护力度,防止算法被滥用于社会操控或剥削。

通过民主监督与多方参与,确保算法技术的发展服务于公共利益,而非仅仅满足商业和权力的需求。 随着AI和预测分析技术的不断演进,人类社会正站在一个关键的历史节点。如何避免陷入由算法主导的单向度路径,保持探索和创新的活力,关系到未来民主制度的走向及社会的整体健康。成为算法问题既是对技术现状的警醒,也是对未来可能性的呼唤。 最终,我们需要重新定义当代数字生活的"算法社会契约",在便利与自由之间找到新的平衡,打造一个既能利用先进技术带来效益,又不失个体独立性和社会开放性的未来。只有这样,我们才能避免成为算法的囚徒,而是真正成为技术进步中的主人,实现积极的社会变革,迎接一个更富创造力和包容性的时代。

。