近年来,人工智能技术呈现出爆发式增长,成为推动数字化转型和智能化发展的关键动力。无论是大型企业还是初创团队,纷纷拥抱AI,希望通过这项"新热潮"提升效率、创新业务模式。然而,在狂奔向智能化未来的路上,安全问题却悄然浮现,甚至因忽视基础安全措施而带来无法估量的风险。尤其是人工智能系统中运行的大型语言模型(LLM)更是成为攻击者的新目标。日前,思科Talos安全研究团队发现超过1100台Ollama服务器公开暴露于互联网,这一数据令人警醒。Ollama作为一款支持本地运行大型语言模型的框架,以其使用便捷、部署灵活等优势受到关注,但也因安全配置不当导致重要入口敞开,成为攻击者可趁之机。

思科的研究表明,这些公开暴露的服务器中约有20%正在活跃运行模型,这意味着攻击者可以利用它们进行各种恶意行为。最直接的风险是资源被盗用,攻击者可以频繁调用模型API,消耗服务器计算资源,甚至可能产生高额费用。此外,多数裸露服务器还暴露了关键的主机信息,助长了针对特定目标的定向攻击。专家特别警示,潜在攻击手段不仅限于资源浪费或拒绝服务,更包括深度的模型复制攻击、内容操控乃至恶意代码注入。通过反复查询对外开放的机器学习模型,攻击者能够逐步复刻模型参数,即所谓的模型提取攻击。这一过程不仅侵犯了知识产权,也为攻击者构建定制化的仿冒模型打开门户。

与此同时,攻击者可利用"越狱"技术绕过模型安全限制,诱使系统输出恶意或违法内容。这类内容滥用不仅损害客户和用户的利益,也严重危害企业声誉与法律合规性。 此外,更为隐蔽和危险的威胁还包括后门植入和模型中毒。远程攻击者若能通过开放接口上传恶意模型或注入代码,将使原有系统完全沦陷,带来更广泛的安全事故。例如,攻击者可能通过植入恶意指令,令模型在特定条件下执行破坏行为,或远程控制服务器实施更复杂的攻击。虽然思科发现大部分暴露服务器处于"休眠状态",未运行任何机器学习模型,使得上述攻击在表面上受限,但这并不意味着安全威胁不存在。

休眠服务器依然开放接口,等待被未授权用户上传模型或篡改配置实验攻击。这种潜伏攻击风险无疑是安全隐患的另一重要部分。此外,即使无人主动利用接口上传模型,暴露的端口还可能遭受资源枯竭、网络阻断甚至横向渗透攻击,危及整个网络环境安全。 从地理分布角度来看,美国拥有最多暴露的Ollama服务器,占比超过三分之一,紧随其后的是中国和德国。这反映出发达国家和技术成熟市场中,人工智能设备的普及速度与安全管理不足面临严重矛盾。许多组织在技术部署过程中,未经充分的安全审查和权限控制,就将AI系统直接面向公众互联网,缺少最基本的身份验证和网络隔离手段。

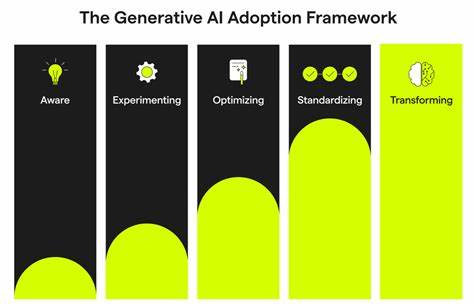

这种"先跑后看"的做法不可持续,也不符合现代网络安全治理的要求。思科安全专家Giannis Tziakouris博士强调,这种现象体现了人工智能系统部署时普遍缺乏安全意识,基本的访问控制、认证机制和网络隔离策略被忽略,给攻击者留下一条条可乘之机。 更令人担忧的是,随着越来越多的AI服务和平台趋向统一采用OpenAI兼容API,攻击者能够凭借较小的适配成本,对多个系统同时发起攻击,进而实现攻击规模的快速扩大。如今入门门槛降低,安全挑战变得更加严峻。这种情况下,呼唤行业统一的安全标准、自动化审计工具以及完善的AI模型部署流程显得尤为重要。标准化不仅可以帮助企业理解、实施和检验基础安全措施,也能推动整体环境的健康发展,避免因个别环节薄弱导致的重大安全事件。

思科的这项发现也暴露出现有漏洞扫描和监测手段的局限性。虽然利用Shodan等网络扫描工具能够快速定位裸露服务器,但其并不能全面评估模型端点的安全态势。未来还需要开发更多结合自适应指纹识别和主动探测技术的新一代安全工具,以覆盖包括Hugging Face、Triton、vLLM等更多主流模型托管平台,帮助安全研究人员和运营方全面把控AI系统安全空间。只有形成多方协作、持续监控的安全生态,才能有效防止人工智能系统被恶意利用。 除了技术手段外,人工智能安全问题还需要从组织层面进行反思和改进。许多组织在引进和部署AI技术时,为了争抢市场先机,往往忽略了与IT和信息安全部门的沟通协调,跳过必要的安全评估流程,导致安全风险无法有效识别和管理。

加强企业安全文化建设,提高员工和管理层对AI安全的重视,是减少类似事件发生的根本途径。同时,政府和行业监管机构也应当出台更为明确的指导原则和法规标准,促进安全意识与技术实践的融合,构建健康可信的AI发展环境。 总体而言,人工智能在给社会带来创新和便利的同时,也伴随着不可忽视的安全挑战。从Ollama服务器暴露事件我们可以清晰看到,加快技术部署的脚步不能以牺牲安全为代价。只有做到技术与安全并重,才能真正保障AI应用的可持续发展。随着技术的不断进步和应用场景愈发广泛,安全风险的形态也将更加复杂多样。

未来,构建系统完善的安全保障体系,不断优化防护策略,提升威胁响应能力,成为人工智能产业健康发展的必由之路。企业、研发团队和安全社区必须携手合作,推动AI技术在安全底线内健康成长,确保数字智能新时代的安全、稳定与繁荣。 。