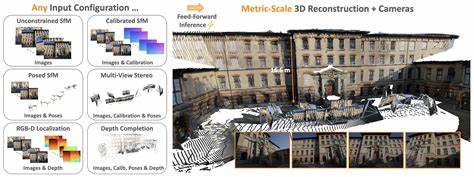

近年来,三维重建技术在计算机视觉领域取得了显著发展,广泛应用于机器人导航、增强现实、虚拟现实以及自动驾驶等前沿领域。作为该领域的领军企业,Facebook Research近期推出了革新性项目MapAnything,展示了其在多视角、多模态图像数据基础上进行精确三维几何重构的强大能力。MapAnything的发布不仅丰富了三维重建的技术生态,也为研究与应用提供了新的思路与工具。 MapAnything是一种端到端训练的变换器模型,核心亮点在于其统一且灵活的结构,支持超过12种不同的三维重建任务,包括多图像结构光束法(SfM)、多视图立体视觉、多模态单目深度估计、点云注册和深度补全等。这种通用性极大地提升了模型的适用范围,用户能够根据需求仅使用图像输入,或结合相机标定、深度信息、摄像机姿态等数据,实现更为精准的三维场景恢复。 从技术实现上,MapAnything采用了前沿的Transformer架构,具备复杂视觉特征的捕捉和建模能力。

其输入端既可支持单图像,也能接受多视角之间的结合,过程仅需一次前向传播即可生成高质量的三维点云和相应的摄像机参数。该模型利用多模态信息协同优化推断,确保恢复的场景几何与真实尺度高度一致,具有较强的实用性和可靠性。值得一提的是,MapAnything的设计兼顾了内存效率,能在显卡资源有限的条件下,依然完成包含数千视角的复杂重建任务。 除了强大的算法基础,Facebook Research还为社区开放了丰富的代码库和训练脚本,涵盖从数据预处理到模型训练再到推理的完整流程。用户可以通过GitHub仓库直接获取资源,轻松在自己的数据集上进行微调和扩展。此外,MapAnything支持与业界主流的COLMAP和Gaussian Splatting集成,进一步增强了模型在实际项目中的兼容性和应用灵活度。

MapAnything不仅在技术层面表现突出,还提供了多种交互式演示平台。官方推出在线Demo和本地Gradio应用,使开发者和研究人员能够直观体验三维重建效果。这些交互式工具优化了用户体验,方便快速验证模型性能,也有助于促进算法的普及和合作交流。 在应用前景方面,MapAnything的多任务统一框架具备极大潜力。对于自动驾驶系统而言,该模型能够基于摄像头采集的实时图像重建周边环境的三维地图,提升导航和避障的精准度。增强现实和虚拟现实领域则可通过高质量的三维场景重建,实现更加沉浸和真实的用户交互体验。

机器人领域可借助该模型增强环境感知和定位能力,推动智能操作的自动化。同时,影视制作、文物数字化保存等视觉内容行业,也能借助MapAnything加快三维建模流程,降低制作成本。 在数据使用和许可方面,Facebook Research为MapAnything发布了两种模型版本:面向科研和学术用途的CC BY-NC 4.0许可版本,以及面向商业用途的Apache 2.0许可版本,满足不同用户的合规需求。此举不仅促进了技术的广泛传播,也为产业化落地提供了法律保障。 从长远来看,MapAnything代表了一种技术趋势 - - 多源多模态信息的融合与统一建模。通过整合图片、相机参数、深度数据和姿态信息,模型能够捕捉更全面的空间几何关系,打破传统单一输入局限。

其模块化设计和开源工具链也为社区合作奠定了基础,推动更加高效且可复用的三维感知算法研发。 随着硬件计算能力的提升及机器学习方法的不断优化,未来三维重建技术将更加精准和高效。MapAnything作为Facebook Research在该领域的重要贡献,为学术界和工业界树立了新的标杆。它不仅提升了从图像直接恢复精确三维结构的能力,也推动了复杂视觉理解任务向更深层次的集成与统一发展。 面对日益增长的应用需求,三维重建的精度和速度要求不断提升,MapAnything通过灵活的输入接口、多任务学习和高效推理架构,展现了良好的适应性和扩展能力。此举不仅加速了相关领域的创新步伐,也为智能机器人、大规模空间重建和虚实融合交互开启了全新可能。

总体而言,Facebook Research发布的MapAnything是三维重建技术的一次重要突破。它基于Transformer模型的强大表现力,实现了统一且高效的多模态场景几何恢复,为未来复杂空间感知和理解的智能系统提供了基础支持。随着时间推移及社区的不断完善,MapAnything有望在更多现实场景中发挥关键作用,成为推动视觉人工智能发展的核心引擎之一。 。