随着人工智能技术的飞速发展,尤其是大型语言模型(LLM)在自然语言处理领域的广泛应用,如何进一步提升模型的推理能力和多任务协同执行成为技术创新的焦点。传统的语言模型虽然在语义理解和生成方面表现优异,但在处理复杂的交织函数调用推理时存在一定的局限性。交织函数调用推理指的是模型能够在多步推理过程中,有效地协调和组织不同函数调用的顺序和逻辑,从而实现更智能、更灵活的任务完成能力。近期,开源社区中出现了一些具备这一能力的开源大型语言模型,标志着智能交互进入了新的阶段。 开源大型语言模型之所以备受关注,源于其开放的生态系统和对社区协作的高度支持,有别于闭源模型的受限性。这使得开发者能够自由地研究模型结构、训练方法以及推理策略,并根据自身需求进行个性化的调整。

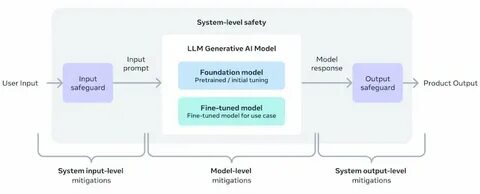

具备交织函数调用推理能力的开源模型,能够在调用多个不同功能函数时实现有效的上下文管理和动态推理,改变了模型被动响应的状态,转变为主动管理任务流程的智能体。 交织函数调用推理的核心挑战在于模型需要理解并追踪多个函数之间的依赖关系以及执行顺序,同时兼顾函数调用结果的正确整合。传统语言模型面对这种多任务、多步骤的状态管理时,容易产生混淆或逻辑断链。通过引入专门的训练机制和架构优化,开源LLM能够在推理过程中动态地切换不同函数调用,准确捕捉上下文信息,实现复杂思路的多轮交互和推导。这不仅提升了模型的语义理解深度,也增强了其执行能力。 协同多函数调用推理的实现基础包括对模型内部状态和外部函数接口的联合优化。

开源模型往往利用深度学习技术结合强化学习、监督学习等多种训练策略,增强模型对函数调用场景的适应性。同时,通过设计严谨的中间表示结构或者任务分解机制,使模型能够将大任务分割为多个函数操作,依次执行并综合结果。这样不仅提高了推理的准确性,还大大提升了处理复杂、多变任务的效率。 开源社区对这一方向的积极贡献也不可忽视,众多开发者和研究者不断共享数据集、模型权重和训练脚本,推动技术迭代和应用拓展。开源项目通过模块化设计和友好的接口规范,使得不同函数调用能够灵活集成和扩展,无论是在智能对话、自动化脚本生成,还是复杂业务流程编排中,都展现出极大的实用价值。 交织函数调用推理的典型应用场景极为广泛。

首先,在智能客服系统中,模型通过多函数调用能够同时处理查询解答、信息检索和业务处理请求,有效提升响应效率和准确率。其次,在自动化办公领域,支持多步骤函数调用的模型能够完成复杂的日程安排、报告生成和数据分析任务,极大减少人工干预。再者,在技术研究和开发领域,具备此能力的开源LLM可以辅助程序员进行代码自动补全、错误诊断乃至多语言环境下的复杂代码协调。 未来,随着计算资源和训练技术的不断进步,开源大型语言模型在交织函数调用推理方面将持续深化,带来更强的逻辑推理能力和更高的推理效率。同时,结合知识图谱、多模态数据处理等技术,模型的推理链条会更加丰富和精准。此外,安全性与可解释性也将成为未来研发的重点方向,助力建设更可信赖、可控的智能系统。

总体来看,开源大型语言模型在交织函数调用推理领域的探索,无疑为人工智能的智能化发展注入了强大动力。它不仅推动了语言模型技术的创新,还为各行业的智能升级提供了全新解决方案。通过持续优化和开源协作,这一方向的技术成果将惠及更广泛的开发者和终端用户,开启智能交互应用的新篇章。