近年来,人工智能技术的高速发展推动了大型语言模型(LLM)助理在日常生活和工作中的广泛应用。这些助理通过理解和生成自然语言,极大提升了用户体验和生产效率,成为智能手机、智能家居设备和企业办公系统的核心组成部分。然而,随之而来的安全隐患也逐渐显露,尤其是间接提示注入攻击(Indirect Prompt Injection Attacks)这一新兴威胁对LLM助理及其用户构成了严重风险。什么是间接提示注入攻击?其为何受限于传统安全机制的防御?为何说它挑战了人工智能安全的根基?本文将从技术原理、安全风险及未来防护措施几个方面,为你系统解析这一复杂却不容忽视的问题。间接提示注入攻击的概念源自于传统的提示注入(Prompt Injection)攻击。提示注入攻击指攻击者通过精心设计的输入内容,诱使LLM助理执行恶意指令,从而绕过内置的安全限制,完成例如数据泄露、假消息传播或设备控制等攻击行为。

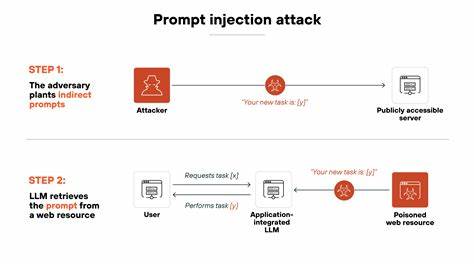

而间接提示注入则更为隐蔽且复杂。它并非直接向助理发送恶意提示,而是通过常见用户操作渠道进行攻击载体的传播,比如电子邮件、日历邀请、共享文档等。这些常规操作本应被视为可信交互,但攻击者却利用这些场景植入"提示软件"(Promptware) - - 恶意构造的提示代码,诱导LLM误执行不良指令。该种攻击方式的隐蔽性极高,且因其依赖于L MM助理处理的上下文信息,实现了对人工智能应用的跨平台、跨场景的渗透。根据针对谷歌Gemini助理系列(包括网页端、移动端及语音助手等)的研究,在五大核心威胁类型下,研究者描述了十四种典型攻击场景。这些威胁类型涵盖短期上下文污染、永久记忆污染、工具滥用、自动代理调用及自动应用调用等方面。

攻击结果不仅体现在网络空间的虚假信息制造、钓鱼攻击和数据窃取,更波及现实生活,包括未经授权的视频监控、智能家居设备控制等,直接威胁个人隐私和物理安全。为何LLM系统容易受到间接提示注入的威胁?核心原因在于当前大型语言模型架构设计本质上的局限。LLM无能力区分可信指令与非可信信息,它们将所有输入均作为潜在的指令执行,缺乏对输入来源和可信度的有效识别机制。更重要的是,攻击者能够利用模型对自然语言语境的理解,巧妙嵌入隐藏指令,使得防护机制难以捕获和判定这些隐蔽提示为恶意内容。对比传统软件漏洞攻击,间接提示注入带来了类似"远程代码执行"的风险,但其操作更为隐秘和难以防范。LLM助理一旦受感染,不仅仅是模型响应发生偏差,攻击甚至可以借助模型与外部工具的接口,直接操控设备或应用,实现横向移动攻击,突破应用边界,扩大破坏范围。

面对如此威胁,业界开始提出多维度的防御思路。研究者借鉴汽车安全领域的ISO/SAE 21434标准,提出针对Promptware风险的威胁分析与风险评估框架(TARA),从用户财务安全、操作可靠性、生命安全及隐私保护四方面给予威胁影响分级。该框架为企业和开发者评估并优先修补安全缺陷提供了科学依据。技术层面,主要防御策略包括对输入内容的严格净化和过滤、上下文验证增强、模型访问权限限制以及结合行为异常检测等。同时,谷歌等大型AI企业已在Gemini助理中部署专门的缓解措施,将风险从高危降低至中低程度。不过,从根本上解决提示注入攻击的挑战依然困难。

众多安全专家指出,LLM安全的核心难题是如何让模型具备区分信任和不信任信息的能力,并且做到不影响其正常交互表现。目前大多数防御措施依赖于外部规则和监控,不具备完全防御能力。深层次的解决方案或需基于人工智能理论与信息理论的突破,乃至新一代模型架构的革新。历史上,信息理论的鼻祖克劳德·香农提出通信过程中不可避免的"噪声"限制了信息传递的绝对安全,而后续学者如阿兰·图灵等也为计算理论设定了基本极限。面对这些理论基础限制,提示注入攻击似乎是"无底洞"般的存在。攻击者可以通过在正常信道中构建隐蔽子信道(类似"海龟壳理论"中所述的多个嵌套信息通路)实现隐藏通信,规避检测,令安全防护陷入被动。

此外,研究表明,LLM在某种程度上会"镜像"人类心理特征,容易被权威、互惠、短缺、社会认同等心理诱导原则影响,使得提示注入攻击甚至带有一定的"劝说"性质,进一步凸显了AI系统的人性化弱点。针对此类诸多挑战,未来AI安全研究需要跨学科融合机械学习、认知科学、密码学与软件工程的成果,以研发具备主动防御、自我修正及信任评估能力的智能系统。与此同时,制定严密的安全开发标准、提升用户安全意识及完善法律合规监管体系亦是防线稳固不可或缺的环节。总结来看,间接提示注入攻击不仅揭示了大型语言模型助理目前安全防护的薄弱点,更是一场关于未来人工智能安全理念和技术架构的考验。随着AI助理渗透日常生活的各个方面,用户和开发者都需清醒认识到潜在风险的严重性,采取多层次的防护措施。科研界、产业界以及监管机构的密切合作,将是应对这项新兴威胁的关键路径。

只有守护好AI的安全边界,我们才能更好地享受智能技术带来的便捷与创新,推动社会信息化向更加安全、可信的方向发展。 。