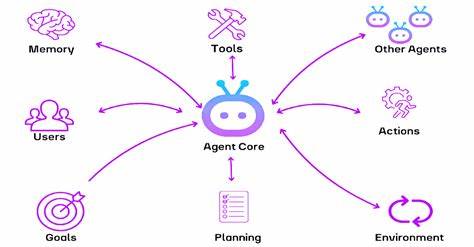

随着人工智能与大规模语言模型(LLM)的快速发展,系统集成和API调用的复杂度日益攀升。Model Context Protocol(简称MCP)正是在这一背景下应运而生,成为连接智能代理与真实世界API的关键中间层。它不仅抽象化了传统API调用,还为AI工具提供了更加便捷、高效的接口,极大地推进了智能系统的应用范围和深度。 MCP的核心价值在于将AI模型的“工具调用”转化为底层的HTTP API请求,从而让智能代理无需关心API细节,就能通过已定义的接口完成数据获取和功能执行。比如,安装了Google Maps MCP服务器之后,AI代理即可调用如地理编码mapps_geocode、地点搜索maps_search_places等功能,简化了复杂接口的调用流程,极大提高了开发效率。 然而,MCP并非一剂万能灵药。

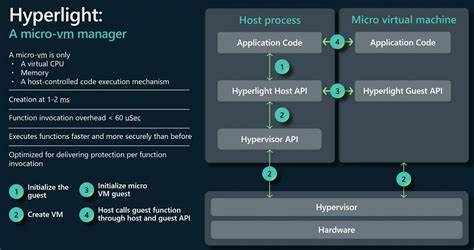

尽管它在一定程度上隐藏了API调用的技术复杂性,实际应用中依然必须面对底层API的稳定性、可用性以及安全性等难题。尤其是在多服务器、多服务交织的场景下,开发者不可避免地遇到第三方API不可用、沙箱环境不稳定、接口尚未开发完毕等诸多挑战。类似以往微服务架构中的“依赖地狱”,这些问题如果不加以解决,将严重阻碍项目进展和系统可靠性。 为了应对上述挑战,API模拟技术成为必不可少的利器。使用API模拟,开发团队可以构建独立于真实API环境的测试与开发平台,确保在生产API不可用或费用昂贵时,仍能高效开展工作。WireMock这一领先的API模拟与测试平台正是应对MCP生态中复杂API依赖的优秀方案。

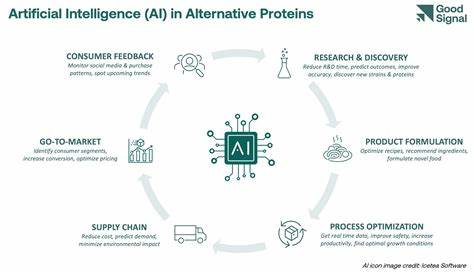

通过模拟API响应、支持复杂测试场景以及动态行为定义,WireMock助力团队进行多步骤、状态相关的流程验证,极大提升开发速度和质量。 MCP的普及也将推动企业加速向AI原生架构转型,这一转变对模拟平台提出了更高的要求。传统的单一REST接口模拟已难以满足需求,支持GraphQL、gRPC等多协议,动态更新API规范以及真实延迟和错误模拟成为新标配。企业级模拟平台不仅要提供灵活配置,还需在安全和性能上达到生产标准,以应对日益增长的API调用量和复杂度。 未来,MCP和API模拟的深度结合将促使AI代理实现更丰富的自动化功能,智能系统能够跨域调用多种服务,实现真正的端到端业务流程。开发者可以专注于业务逻辑和智能模型优化,而不必为调用链中复杂的API错误和不确定性耗费大量时间。

借助完善的模拟环境,还能实现持续集成与持续交付,提高软件发布速度和代码质量。 从宏观角度看,MCP代表的不仅是技术协议,更是一种架构思想的跃升——通过标准化的模型上下文实现各方系统的协同,让AI驱动的应用真正落地企业核心业务。与此同时,API模拟作为关键基础设施,将确保这一愿景得以高效稳定地实现,避免陷入传统多系统集成的瓶颈。 简而言之,MCP是API世界的下一场革命,从根本上改变了我们与AI和服务系统交互的方式。对开发团队来说,积极拥抱MCP技术的同时,必须同步部署强大的API模拟和测试工具,才能在AI高速发展的浪潮中立于不败之地。跨越初期“快速上线”的阶段,关注质量、性能和安全,打造可持续的开发流程,才是未来AI应用成功的关键。

综上所述,MCP为API调用提供了新的抽象层和操作模式,使AI与现实数据服务之间的连接更为顺畅和智能。而解决其引发的API依赖难题,则需要高度成熟的API模拟技术加持。期待未来更多创新的API模拟方案与MCP技术融合,加速智能应用的普及与深化,为全行业数字化转型注入强劲动力。