近年来,人工智能(AI)技术迅猛发展,带来生产力的极大提升。然而,正如所有科技进步一样,AI也被不法分子利用,推动网络诈骗手法升级,产生了更具欺骗性和复杂性的攻击形式。随着微软发布的《AI驱动欺骗:新兴诈骗威胁与对策》报告指出,2024年至2025年间,全球范围内因AI技术促成的网络欺诈行为显著增加,且每年财富损失高达数十亿美元。恶意攻击者利用AI生成逼真的文本、图像和虚拟场景,甚至模拟真实人员进行交流,使受害者更难分辨真伪。本文将深入探讨AI如何助力更高级的骗局,剖析典型诈骗案例,并提出有效的防范措施,帮助个人和企业筑牢网络安全防线。人工智能在诈骗领域的多样化应用极具危险性。

例如,在电商领域,诈骗者通过AI技术快速搭建虚假购物网站,生成专业的商品描述、逼真的产品图像和虚构的用户评价。这些网页与正牌电商平台几乎毫无差别,普通消费者很容易上当受骗。诈骗者往往会营造紧迫感,设置倒计时促销、限时优惠等虚假诱导,迫使用户匆忙交易,忽视安全警示。对抗这类骗局,用户可以选择具备防钓鱼和域名伪装识别功能的浏览器,如微软Edge,内置深度学习技术,实时提醒潜在假冒网站。同时,避免冲动消费,警惕仅支持无保障支付方式的交易,能有效降低上当概率。此外,点击广告链接前应确认其真实性,切勿盲目轻信网络推广。

就业诈骗在近年来也呈现新趋势。不法分子利用AI生成虚假招聘信息,通过合法招聘平台发布,甚至盗用真实公司账户发布招聘广告,虚构招聘流程,给求职者带来极大迷惑。通过AI技术,甚至可实现自动化面试和邮件交流,使骗局更具针对性和隐蔽性。求职者应提高警惕,避免向陌生或未核实的机构提供个人敏感信息,如银行账号或身份认证资料。对招聘方的合法性进行多平台核查,验证公司网址、在职人员信息、招聘口碑等是关键手段。求职过程中遭遇声称无需经验却提供高薪的岗位时,尤其要保持怀疑态度。

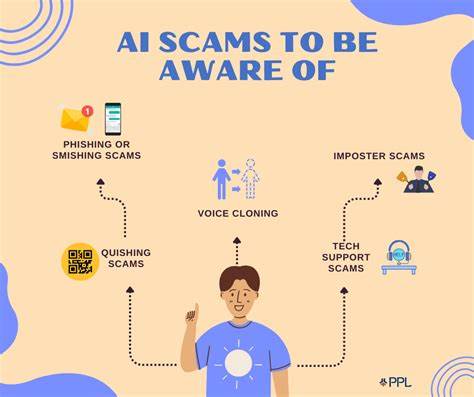

技术支持诈骗依然是网络犯罪的高发类型。不法分子通过假冒IT服务人员,在电话、短信或邮件中声称用户设备存在安全风险,诱导受害者安装远程控制软件,从而窃取信息或植入恶意软件。该类型诈骗往往不依赖AI,但其社交工程手法灵活,高级诈骗团伙如Storm-1811利用AI配合声纹仿真和自动拨号技术,进一步提升欺骗效果。微软建议用户在面对自称技术支持的主动联系时保持警觉,选择官方提供的远程协助渠道,避免授予全权限的远程访问。企业方面,AI的安全应用更显重要。企业若未能及时引入AI防御系统,将在与攻击者的博弈中明显处于劣势。

利用AI监控异常访问、自动识别恶意行为和伪造内容,能够大幅提高威胁识别速度和准确率。强化多因素身份认证,并定期更新安全策略,能有效抵御基于AI生成的欺诈攻击。面对AI辅助的诈骗,用户和企业需树立全方位的安全意识。定期更新设备和软件,避开不明网页和广告,慎重核实信息和交易细节,是关键防线。针对电子邮件和社交网络中的陌生链接保持警惕,防止被骗取账号信息。全球安全厂商正加紧推动AI技术在网络安全领域的应用,如利用机器学习检测异常行为,阻断自动化攻击,实现精准封堵潜在威胁。

作为普通用户,保持信息安全教育的持续学习也尤为重要。人工智能赋能的诈骗手段日益多样,从假冒网站、电商陷阱到虚假招聘和技术支持骗局,威胁无处不在。只有不断增强安全防范意识,紧跟技术变化,科学应用智能工具,才能有效守护个人与企业的数字资产。未来,随着AI的进步,网络诈骗趋势必将更加隐秘和智能,唯有主动布局防御,建立稳固安全体系,才能在这场新型网络攻防战中立于不败之地。