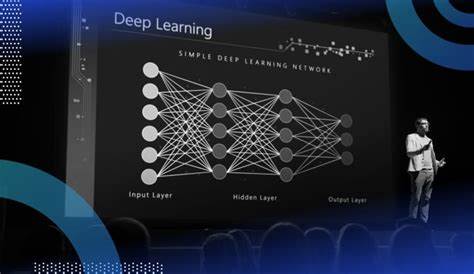

近年来,深度学习作为人工智能领域的重要分支,吸引了无数学者和开发者的关注。然而,对于许多非计算机专业出身的人来说,进入深度学习的世界仍然充满挑战。本文将通过一位普通开发者的学习与成长经历,探讨如何从零开始学习深度学习,突破技术壁垒,构建开源项目,并最终获得研究岗位的珍贵经验。帮助更多有志者坚定方向,科学高效地提升技能。作者最初并未在计算机专业深造,反而拥有美国历史专业的本科学历,学业期间甚至曾屡次挂科。这一背景使他与众不同,也让他的学习路径更具启发意义。

早在2012年,他便开始涉足机器学习和Python编程,但当时却因深度学习的复杂数学背景而自我设限,觉得这条路难以逾越。实际情况证明,这种心态误导了他整整十年。重新审视深度学习时,他意识到过去从上到下、机械拼接模型的方法并不可取,基础不牢,终将碰壁。因此,他果断调整策略,采取由下至上的学习方式,即优先掌握数学与理论基础,逐步构建完整认知体系。强大的Python编程能力是他学习过程中至关重要的基石。Python的简洁和丰富生态让它成为人工智能领域的通用语言,无论研究还是工程实践,都绕不开这一技能。

同时,数据清洗工作占据了大部分时间,充分说明数据质量的重要性。所谓“好的模型离不开好的数据”,数据处理能力是深度学习实践者必须牢牢掌握的技能。此外,务实的态度在学习过程同样意义重大。深度学习充满了各种深入探索的诱惑,比如追求最优算法架构、微调激活函数等等,若一味深究,可能导致效率低下、进展缓慢。学会分辨何时深入、何时以简单方案先行,是走得更远的关键。在学习资料选择上,作者主攻经典教材《深度学习》(Deep Learning Book),通过细致阅读深入理解概念、数学原理,辅以习题编码,加深印象。

同时,他推荐配合使用《数学之于机器学习》(Math for Machine Learning)等资料,弥补数学基础不足。此外,fast.ai与Andrej Karpathy等人的视频课程也被视为优质、高效的补充学习渠道。即便是看似已经落伍的网络结构如卷积神经网络(CNN)和循环神经网络(RNN),也依然值得学习。毕竟许多方法不断被复用甚至回潮,基础扎实才能灵活变通。不仅如此,他发现边学边教的方式极具成效。在自学期间,他着手设计了名为“Zero to GPT”的课程,将所学知识系统化、对外分享。

教学活动促使其不断巩固并深化理解,同时解决不懂问题,形成良性循环。基础掌握后,他转向分析与实现近年重要深度学习论文,包括注意力机制、Transformer架构、Switch Transformer、低秩适配(LoRA)、视觉Transformer以及GPT-2模型等,通过PyTorch框架在Google Colab等平台实践。这样做不仅深化了理论理解,也提升了动手能力,有助于应对实际项目中的挑战。模型微调被认为是当前快速切入深度学习训练的便捷路径。作者推荐使用Huggingface Transformers这一丰富且功能完备的库,结合PyTorch完成微调任务。通过加入社区Discord服务器如Nous Research和EleutherAI,可以实时了解前沿动态,参与讨论,获得灵感。

针对资源有限的情况,将模型规模控制在7亿参数以下,使用LoRA技术降低训练成本,为实验提供便利。作者通过微调专注改善代码生成能力的模型,选取StackOverflow等公开数据集,对模型进行个性化训练。此举不仅提升了技能,也感受到从架构设计、数据处理到计算限制和模型表现间的紧密联系,理解了深度学习模型构建的全流程。在解决实际问题时,作者注意到优质训练数据却往往被锁在PDF教材等格式中,难以直接利用。针对这一痛点,他开发了Marker工具,通过避开繁琐的OCR步骤,结合多模型串联与启发式算法,实现了高效准确的文本抽取,速度相比现有方案快上十倍。该项目启发他进一步探索文本检测、方程式识别、OCR模型与图片布局分析等多项研究,均改造自现有架构,调整层结构、损失函数,精心设计数据集与训练流程。

令人印象深刻的是,众多模型体量均未超过三亿参数,仅凭4张A6000显卡即可完成训练,体现了深度学习不必依赖巨型算力。以上实践凸显了三点关键体会——扎实基础是训练高质量模型的保障,发现并解决有意义问题是技术成长的源泉,普通配置设备即可产生实质性成果,打破了深度学习入门门槛高的常见误解。作者始终推崇开源精神,公开发布所有科研项目,尤其是数据层面工具。开放高质量训练数据有助降低行业壁垒,减少模型开发的垄断风险。开源行为亦使得个人作品获得更广泛关注,积累重要的社会资本。有意思的是,作者原本计划将开源工具商业化,未曾考虑加入企业团队。

但随着作品成效显现,知名研究者Jeremy Howard联系他加入answer.ai研究实验室。他接受邀请,与顶尖团队并肩工作,助力社会,并进一步增强专业技能。开源促进了人才曝光,同时显著提升了技术水平,成为职场突破的重要助力。展望未来,作者计划继续保持训练和开源节奏,聚焦数据栈优化和模型创新,推动知识共享与技术进步。对于渴望进入深度学习领域的人,他建议扎根基础理论,结合项目实践,积极参与社区交流,勇于开源分享。如此方能在竞争激烈的AI时代中找到立足点,创造属于自己的价值。

深度学习的成长之路不必一蹴而就,重要的是树立明确目标,保持耐心与恒心,不断学习,敢于探索,方能收获丰硕成果。借鉴作者经历,我们看到非传统背景同样可以逆袭AI前沿,只要选对策略,善用资源,用心实践。未来的深度学习领域,欢迎每一位热爱创新、勇于挑战的奋斗者加入,共同开拓智能时代的新篇章。