近年来,人工智能技术在全球范围内不断加速发展,改变着社会的方方面面,从数据分析到自动化操作,从医疗诊断到智能制造,AI的应用无处不在。加拿大作为科技创新的重要一员,也积极布局人工智能领域,任命专门的人工智能部长以促进相关政策落实并推动产业发展。新任加拿大人工智能部长埃文·所罗门(Evan Solomon)以其乐观的态度展现出对AI潜力的信心,认为AI正在实现智能民主化,大大提升效率和决策质量。然而,盲目的乐观看待AI的发展风险极可能带来严重的社会隐患,值得深刻反思和警惕。 人工智能在高效生产力的背后,也伴随着诸多不可忽视的负面效应。首先,黑客和网络犯罪分子利用AI自动化工具迅速开展复杂的网络攻击,极大提升攻击效率和隐蔽性。

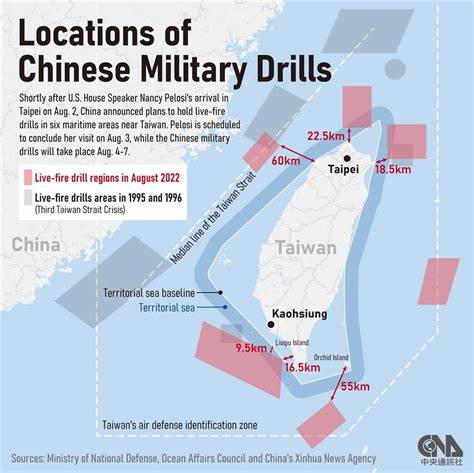

例如,人工智能公司Anthropic曾曝光其Claude聊天机器人被黑客用于开展全方位的网络犯罪活动,从侦查企业基础设施、生成恶意软件到数据分析勒索,AI简化了原本繁重的犯罪流程,令执法难度倍增。这种恶意使用AI工具的现象显示了技术开放性与安全威胁间的矛盾。 其次,AI技术被军方和政府机构用于秘密操控舆论与信息战。美国军方开展的AI驱动的隐性影响力行动,目的在于压制不同声音。全球各种国家纷纷依赖AI制造虚假信息、伪造视频,甚至操纵社交媒体舆论场,制造关于重大政治事件、军事冲突的虚假报道,误导公众。例如,近期中东冲突期间,以色列和伊朗相关势力通过AI生成虚假视频,制造假象以达到心理战目的,不法分子利用AI技术污染信息环境的程度空前加剧。

加上多家所谓"暗黑公关"公司将意识形态操控作为服务项目,借助AI实现选举干预和政治操控,极大威胁民主机制与社会稳定。 在面对AI带来的这些严峻挑战时,加拿大政府和执政者必须跳出单一的地缘政治框架。当前,大部分国家将AI恶用问题简单归结为"外国干涉",这一视角忽略了AI技术对国内政治社会的潜在影响。恶意AI系统既能被异国势力利用,也可能被本地利益集团或跨国企业作为攻击手段,打压举报者、掩盖不法操作,形成难以捉摸的威胁网络。同时,将挑战解读为军备竞赛或技术对抗有可能激化矛盾,导致监管竞赛和"技术军备"升级,进一步恶化信息环境。 AI企业自身虽然开展了威胁情报团队等自我约束措施,但由于其业务模式和利益驱动,存在监督不足和利益冲突的问题。

如同社交媒体平台在内容监管上的无力感,AI公司的监管部门类似拳击场上的急救医务人员,始终处于矛盾和压力中,难以真正根除潜在风险。加之平台对研究人员和独立监督机构设置壁垒,包括关闭公开接口和采取法律行动,严重阻碍了公众和学术界对AI负面影响的深入调查和公开监督。 因此,加拿大乃至全球范围内的治理急需转向更加透明和负责任的方向。政府应当制定强制性透明度报告制度,确保AI平台按期公开相关运营数据,同时推行独立的第三方审计,强化对AI算法偏见、不当使用等方面的检查与纠正。技术平台必须向公共利益研究者开放访问权限,消除研究和监督"黑箱"现象。此外,应重点支持针对AI对心理健康,尤其是青少年受众的影响的科学研究,防止技术冲击造成代际伤害。

对被证实涉入AI恶意活动的企业与组织,必须采取严厉的行政和法律制裁,阻断恶意利用的路径。 人工智能以其卓越的语言建模和推理能力,本应成为促进人类认知和社会进步的重要手段。但现实中,技术力量却在不受控的情况下被动为误导、操纵和破坏提供了新工具,导致公共话语权的扭曲和知识环境的污染。所谓"智能民主化"理应是普及教育和知识共享,却有可能演变为"集体认知受损",社会陷入信息混乱和信任危机。加拿大新任AI部长不仅要拥抱技术带来的机遇,更必须正视人工智能的阴暗面,推动政策和产业规范化发展,保护公共利益,积极构建安全、透明、公正的AI生态。 未来,加拿大作为全球重要的技术创新中心,承担着引领负责任AI发展的国际使命。

通过强化法规建设、支持跨界合作和持续的公众教育,加拿大有机会在全球AI治理领域树立典范,实现科技进步和社会正义的双赢。只有摒弃盲目乐观,全面审视人工智能的复杂维度,政府和社会各界共同努力,才能真正发挥AI的正面潜力,防范其潜在危害,打造更加美好、安全的数字未来。 。