近年来,随着大规模预训练语言模型的广泛应用,模型参数规模不断攀升,从数十亿到数千亿参数,模型体积动辄达到十几GB甚至数十GB,给存储和计算带来了极大的挑战。如何在保证模型推理准确率的同时,显著减少模型占用的存储空间和计算资源,成为人工智能领域研究的焦点。量化技术作为一种有效的模型压缩手段,近年来取得了飞速发展。传统的8位和16位量化已经相对成熟,但对于更细粒度的4位量化,存在精度损失大的瓶颈。Unsloth团队提出的动态4位量化技术,为解决这一难题带来了新的突破。Unsloth的动态4位量化基于BitsandBytes的4位量化基础,创新性地引入动态选择不量化部分关键参数的方法,有效减少了精度损失。

与传统的全局4位量化不同,Unsloth能够根据参数的重要程度智能判断是否对其进行量化,从而在减小模型体积的同时最大程度地保持模型的准确性。以典型的Llama 3.2视觉模型为例,完整的16位模型大小约为20GB,使用BitsandBytes的4位量化后体积大幅缩减至约6.5GB,节省了68%的存储空间。然而,该量化模型在特定任务中的表现仍存在细微差距。采用Unsloth动态4位量化后,模型只增加不到10%的显存开销,却成功恢复了图像描述中对图像意图的准确表达,效果接近16位原始模型。此外,Unsloth的动态机制在微软的Phi-4模型上的应用也印证了其强大的性能。团队修复了Phi-4中的若干关键bug,并将动态4位量化后的模型提交至Hugging Face OpenLLM排行榜,在多任务理解测试(MMLU)等基准中取得接近16位模型的高分,明显优于传统4位和官方16位实现。

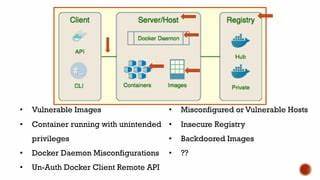

更为引人关注的是,Unsloth不仅在语言模型领域展现优势,对视觉多模态模型同样适用。Qwen 2.5视觉语言模型的2亿和7亿参数版本,若采用传统4位量化,模型性能严重下降,甚至产生错误的图像描述。通过动态4位量化,模型在内存开销略微增加(相较全4位多出约450MB)情况下,准确还原了原始图像内容,表现恢复至与16位模型相当的水准。可见,纯粹的盲量化往往导致激活量化误差巨大,参数量化误差尤其在前几层和特定权重矩阵存在明显异常,而动态选择性量化策略有效缓解了这一问题。Unsloth的团队还发布了多个基于其动态4位量化方法量化的视觉模型,如Llama 3.2视觉11B版本、Pixtral 12B视觉模型等。对于Pixtral这类更大型的视觉模型,传统4位量化引入的误差尤为明显,动态4位量化方法虽然不能完全达到16位精度,但通过调整“坏模块”的量化策略,能够显著提升模型对细节的捕捉能力,特别是在复杂医疗影像分析如儿童牙齿X光分析中表现抢眼,甚至超越了8位量化的表现。

模型精度与压缩比例之间的权衡是量化研究的核心。Unsloth的动态方法通过灵活关闭部分关键层的量化开关,放弃了简单统一量化方案,换取更精准的推理表现。这种策略带来的显存占用增加较为有限(通常低于10%),但对提升多模态模型智能理解能力有重要价值。除了在模型量化本身的创新,Unsloth在社区推广和应用体验方面也做出巨大努力。团队不仅提供了基于Hugging Face的公开量化模型,还发布了配套的Colab笔记本,方便开发者在Llama 3.2视觉模型上体验和微调动态量化技术。此外,Unsloth积极构建技术交流平台,包括Reddit社群、Discord服务器,以及Twitter频道和定期的新闻通讯,形成开放共享的社区氛围,推动量化技术面向实际工业应用普及。

Unsloth动态4位量化的成功,既得益于对模型参数细致入微的分析,也离不开对激活分布和误差动态变化的深刻理解。其分析结果显示,不同模型结构和不同层次的权重矩阵对量化误差的敏感度存在显著差异,例如Llama大模型的交叉注意力层输出投影部分普遍需要保留高精度,视觉编码器的量化误差比预期更大。通过精准定位“量化瓶颈”,Unsloth实现了既节省存储又确保性能的平衡。从更广阔的角度看,Unsloth动态4位量化为未来AI模型的轻量化部署提供了宝贵参考。随着多模态模型和超大规模语言模型不断涌现,动态量化这类策略将成为主流趋势,有望推动智能设备端的推理性能提升,降低能源消耗,促进边缘计算和实时应用的普及。总结来说,Unsloth动态4位量化技术突破了传统4位量化带来的性能瓶颈,智能识别并保护关键参数,实现了高效压缩与高精度推理的统一,特别在微软Phi-4、Llama 3.2视觉系列和Qwen系列多模态模型中表现优异。

无论是学术研究者还是工业应用开发者,都能从其开源成果和社区支持中获益,加速大模型的普适化应用。未来,随着量化策略的进一步细分和结合高效硬件架构,动态量化有望推动AI模型向更高性能、更低资源需求的方向发展,为人工智能技术落地创造更多可能。想要了解更多Unsloth动态4位量化技术及相关实测结果,欢迎访问其官方文档及GitHub资源,或加入社区进行深入交流。持续关注Unsloth的最新技术动态,将帮助您把握AI算力优化的前沿趋势。