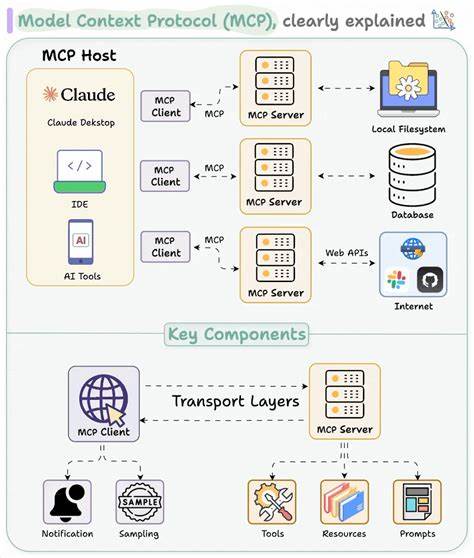

随着人工智能技术的快速发展,越来越多的企业和用户开始依赖AI助手来提升工作效率和生活品质。然而,AI助手与外部系统交互时,其潜在的安全风险也逐渐显现,如何保证AI操作的安全性,防范意外或恶意行为,成为急需解决的难题。在这一背景下,Maybe Don't AI MCP Gateway 应运而生,作为AI与外部工具之间的安全防护网,它以高效监控与智能阻止潜在危险操作的能力,成为保障AI在复杂环境下安全运行的利器。Maybe Don't并非简单的防火墙,而是专门面向AI助手调用外部服务的安全网关。利用Model Context Protocol(MCP)协议,它充当中间层,截获所有AI助手发出的工具调用请求,实时监控并分析这些请求。当发现请求可能带来危险时,比如删除重要文件、访问敏感信息、执行恶意代码等,网关会立即阻断操作,保障系统安全。

其强大的日志记录功能还能完整追踪所有操作,便于事后审计与取证。部署Maybe Don't不仅提升了系统安全等级,也增强了AI服务的可控性,对企业合规与风险管理尤为关键。在安装与使用方面,Maybe Don't提供了多平台支持,包括Mac(Apple Silicon 和 Intel架构)、Windows及Linux多种版本,覆盖绝大多数开发环境。用户仅需下载对应版本的二进制文件、配置gateway-config.yaml即可快速启动。同时,网关支持多种与下游MCP服务器的连接方式,如HTTP、标准输入输出(STDIO)及服务器发送事件(SSE),适合不同复杂度的场景需求。配置灵活且扩展性强。

也支持Docker容器运行,方便在云环境或容器化架构中部署,提升了运维效率。操作时,用户需准备必要的环境依赖与API密钥,例如OpenAI API密钥用于AI验证,GitHub Token用于认证下游MCP服务器,确保系统安全连贯。配置过程比较直观,官方文档和示例配置文件提供了丰富的指导,几分钟即可完成基本环境搭建。核心功能中,Maybe Don't融合了两大类别的策略验证机制。首先是基于CEL(Common Expression Language)的规则验证,这种规则是确定性的,可以精细定义每一条请求的允许条件,例如禁止kubectl删除命名空间等高风险操作。通过CEL规则,用户可以自定义符合自身安全策略的过滤条件,灵活应对实际业务需求。

其次是AI驱动的策略验证。利用OpenAI兼容API,Maybe Don't内置基于自然语言理解的深度分析模型,针对工具调用内容进行语义审核。它能智能识别包括大规模文件删除、系统目录访问、危险命令执行、凭证文件读取、未经授权的网络请求等多类复杂风险操作。这种AI验证极大提升了规则识别能力,对传统规则难以覆盖的边缘情况表现优异。用户还可以定制AI验证规则,根据具体场景调整严厉度和风险判定逻辑,构建专属的智能安全屏障。不仅如此,Maybe Don't采用了完善的审计机制,所有发起的工具调用都被记录到日志文件或直接输出到标准输出,方便进行实时监控和后期分析。

日志内容包括请求详情、阻断原因及验证结果,确保安全事件的可追溯性,为合规审计提供了技术支撑。安全配置与最佳实践方面,官方建议使用环境变量管理密钥和Token,避免在配置文件中硬编码敏感信息,降低泄露风险。建议同时启用CEL和AI验证,以实现确定性规则和智能分析的双重保障。管理员可以定期更新规则文件,结合实际攻击案例不断完善防护体系。此外,Maybe Don't不仅适用于企业级生产环境,也非常适合开发测试阶段提供安全保障。通过模拟真实攻击场景及时发现潜在风险,有效避免因AI助手误操作导致的重大损失。

而且得益于其支持多服务器配置,用户可灵活将其作为统一安全网关,管理多个AI助手及服务端点,大幅简化安全管理复杂度。从行业趋势看,随着AI工具嵌入企业日常运营的深入,类似Maybe Don't这样智能安全中间件的需求日益增长。它代表了一种新型的AI安全理念,即不再仅依赖传统权限控制和网络隔离,而是通过智能分析与动态响应机制,实时防御复杂多变的风险。未来,该类技术有望在更多垂直领域广泛应用,如金融风控、医疗数据保护、云服务安全等,保障AI赋能业务的同时守护信息资产的安全。总结而言,Maybe Don't AI MCP Gateway通过在AI与外部系统之间建立坚固屏障,实现了安全与效率的完美平衡。其多样化的配置方式、强大的策略校验能力及灵活的审计功能,使其成为保护AI调用安全的关键工具。

无论是技术爱好者还是企业安全团队,深入了解并合理利用Maybe Don't,都是迈向智能安全新时代的重要一步。未来,随着AI技术的不断升级以及攻击技术的演进,类似Maybe Don't这样的智能安全中间件将发挥更大作用,成为构建可信赖AI生态系统的基石。在实际使用中,用户应关注官方最新版本和规则更新,及时调整策略配置,确保安全防护效果最大化。同时,结合自身业务需求不断优化AI验证模型和CEL规则,打造符合自身风险承受能力的专属防火墙。如此,才能真正实现“让AI聪明而不可伤害”,迎接人工智能时代安全挑战的新篇章。