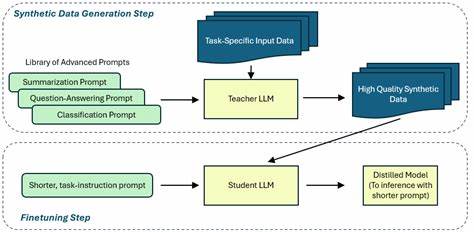

随着人工智能技术的高速发展,模型蒸馏(Model Distillation)作为一种提升模型效率和性能的重要手段,正逐渐引起学术界与业界的广泛关注。尤其是在开源模型范围内,蒸馏技术的应用日益丰富,成为研究者探寻新理论和创新方法的焦点。许多初创企业和研究团队开始关注一个关键问题:基于开源模型进行蒸馏是否足够创新,能够成为发表科研论文的切入点?此外,如果其中蕴含创见性思路,风险投资者是否会认可其独特价值?本文将深入探讨这一话题,解读背后的逻辑,并预测蒸馏技术的未来走向。模型蒸馏起源于通过从一个庞大、复杂的“教师模型”中提取知识,训练一个结构更轻量、更高效的“学生模型”,以实现更快速、更节省计算资源的推理过程。这种技术在自然语言处理、计算机视觉等多个领域均表现出显著优势。开源社区中涌现了大量重量级模型,诸如BERT、GPT、ResNet等,研究者能直接获取这些模型资源,基于此进行蒸馏,提升模型应用的灵活性与普适性。

然而,是否将这种基于开源模型的蒸馏工作视为科研论文的基础,需从创新性和技术深度展开全面考量。科研论文的价值在于提出全新的理论、方法或系统,解决尚未明确解决的挑战或提供对现有技术的本质性改进。单纯复制蒸馏流程而无新颖算法设计,往往难以满足发表要求。若能在蒸馏算法方面进行突破,比如提出更高效的学习策略、适应特定任务的定制化蒸馏方法,或在蒸馏框架中融合多模态数据,实际上为学术界和工业界带来实质价值和新视角,这样的研究就具备较高的论文发布潜力。值得注意的是,开源模型的广泛可获得性为研究者降低了门槛,使其可以专注于核心算法创新,而非从零训练庞大模型,这种优势使得蒸馏成为探索模型压缩和加速的理想途径。风险投资者对于基于蒸馏技术的项目关注点则更偏向于商业落地和独特竞争优势。

如果一个团队能够围绕开源模型蒸馏,打造出具备显著性能优化、极佳用户体验或差异化应用场景的产品,且该过程伴随技术专利或创新解决方案,投资吸引力将明显提升。尤其在大模型计算资源消耗日益成为瓶颈的今天,高效模型蒸馏解决方案具备广阔市场前景和商业价值。此外,科研团队合理利用开源资源展开蒸馏研究,还能促进AI社区整体技术生态的发展,推动模型普及和民主化,降低技术门槛,进一步激发创新动力。在撰写基于蒸馏的科研论文时,研究者应详细阐述自己的工作如何突破现有框架,解决具体难题,提升模型表现或效率,避免重复已有实验,从理论和实践两端展现创新深度。例如,探索新型知识传递机制、优化蒸馏中间层的表征选择、提升学生模型对原模型的泛化能力,均是有价值的研究方向。总结而言,蒸馏开源模型本身虽然是一种常见技术手段,但只要结合独特思路和创新算法,完全有可能成为科研论文的重要主题。

在市场和资本层面,只要研究成果能够转化为领先产品和技术壁垒,同样能够获得风险投资的认可和支持。未来,随着大模型规模持续扩大,蒸馏技术必将作为提高效率和降低成本的核心路径获得更多重视和发展机会。研究者应抓住这一趋势,积极探索创新点,推动人工智能技术迈向更高水平的融合与实践。