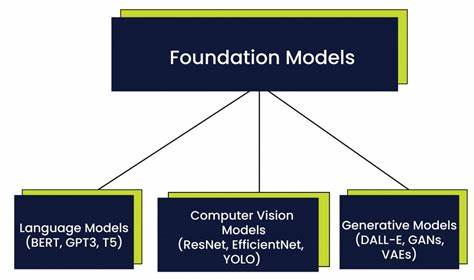

在人工智能领域,语言模型已经成为理解和生成自然语言的核心工具。大语言模型(LLM)如GPT系列通过庞大的文本数据训练,表现出强大的语言理解能力。然而,面对复杂的未来预测任务,传统大语言模型存在一定的局限性。近年来,关系基础模型(Relational Foundation Models)作为一种新兴的基础架构,展示出超越传统方法的独特优势,为预测未来提供了更深入的洞察力。关系基础模型的核心在于深刻捕捉数据之间的关系和结构,而非单纯依赖文本模式的统计相关性。通过模拟实体与实体之间的多维联系,这类模型可以更准确地推断和预测未见信息,进而克服大语言模型在推理复杂性和语境连贯性方面的不足。

传统大语言模型在处理相关信息时往往侧重于序列建模和上下文捕捉,但它们缺乏对多实体间动态关系的系统性理解。关系基础模型则利用图结构和关系推理机制,使得模型能够更灵活地应对诸如时间序列分析、因果推断和复杂场景模拟等挑战任务。关系基础模型通过整合知识图谱、结构化数据以及非结构化文本,使人工智能能够从更加丰富、多维的知识体系中学习,进而实现对未来事件的推测。比如,在医疗诊断中,模型能够关联患者的多项临床指标、历史病例和医学文献,预测疾病发展趋势。在金融领域,它们可以连接市场动态、政策变动和公司财报,辅助投资决策。除了在预测能力上的提升,关系基础模型还带来了更高的解释性和透明度。

传统的黑盒型大语言模型难以向用户清晰传达其决策依据,这在某些高风险领域限制了它们的应用。关系基础模型通过显式表达实体关系和交互过程,使模型推理路径更加可追踪,增强了用户对结果的信任感和理解度。要实现关系基础模型的成功应用,核心挑战之一是如何高效地构建和维护高质量的关系网络。数据的多样性和异构性需要强大的数据融合技术,同时保证关系信息的准确性与时效性。此外,模型的设计需要兼顾推理深度与计算效率,以满足实际应用中的性能需求。随着计算能力的提升和算法的不断优化,关系基础模型在自然语言处理、计算机视觉乃至跨模态理解等多领域展现出广阔前景。

它不仅可以弥补大语言模型的短板,还为人工智能系统提供了更智能的推理框架。未来,关系基础模型有望成为促进AI从数据驱动向知识驱动转型的重要里程碑,加强机器对现实世界复杂关系的理解,推动智能系统在医疗、金融、教育、智能制造等领域实现突破性进展。总结来看,关系基础模型以其独特的多实体关系建模和推理能力,成为了人工智能未来预测领域的有力工具。它不仅解决了大语言模型在复杂推断上的困难,也为人工智能的智能化和可解释性奠定了坚实基础。随着技术的不断发展,关系基础模型必将在推动智慧社会建设中发挥核心作用,成为未来人工智能发展的关键引擎。