随着信息技术的飞速发展,恶意软件检测技术已经成为保障数字安全的重要手段。无论是病毒、木马还是钓鱼网站,数字世界中的威胁防御系统已经非常成熟。然而,随着增强现实(AR)和虚拟现实(VR)技术的普及,人们开始畅想一个全新的安全境界:现实世界也能像数字世界一样,配备类似恶意软件检测的智能系统,帮助人们辨别虚假广告、错误信息甚至欺诈行为。这种设想令人激动,但现实世界要实现这样的“恶意软件检测”却面临众多复杂阻碍。首先,现实世界的信息复杂多变,远比数字环境难以标准化和判定。在网络世界,信息的来源、传播路径以及内容数据都可以数字化处理和分析,算法通过学习历史数据能够不断进化加强风险识别能力。

然而现实中的信息更多依靠视觉、声音及其他感官刺激,且背景环境千差万别。例如,一则广告是否误导、一个陈述是否正确,往往需要综合大量背景知识和语境理解,而这些在当前人工智能领域还难以完美复制和普及。其次,人们对于自主判断能力的依赖也是一个重要因素。正如有人在技术讨论中指出,若完全依赖设备来判断真伪,个人辨别信息的能力将逐渐丧失。设备故障、断网甚至被黑客入侵后,如果用户盲目相信系统的判断,反而可能陷入更大的风险。这种对人类自主思考和学习能力的潜在削弱,是设计类似现实世界恶意检测系统时需严肃考量的伦理议题。

此外,现实世界的隐私和安全问题也为实施这类技术设置了障碍。设备若要实时分析周围环境中的信息,意味着需要不断采集大量的视觉、音频甚至行为数据。这些数据涉及用户隐私,以及周边无数人的隐私权,如何保证数据安全,避免滥用和泄露,是极其重要的问题。监管法规尚不完善的情况下,很难让用户完全信任这套系统。此外,从技术实现角度来看,增强现实设备目前在硬件性能、续航能力以及网络连接等方面仍有限制。实时处理复杂的环境信息并准确判断其真伪,需要极高的计算能力和低延迟的连接。

现有的移动设备和AR眼镜尚无法像数据中心那样强大和稳定,因此要实现精准且实时的“现实恶意软件检测”仍是技术难题。更重要的是,对现实世界信息进行自动化判断,难免面临文化差异和主观评判标准的问题。不同地区、社群对信息的认识各异,一条信息在某些文化背景下或许被视为误导或欺诈,而在另一些文化中则被接受甚至认可。这种多样性与复杂性使构建统一的检测标准变得异常困难。即便是最先进的人工智能系统,也可能因训练数据的偏差和算法的局限而产生错误判断。尽管如此,现实世界的恶意软件检测设想并非毫无前景。

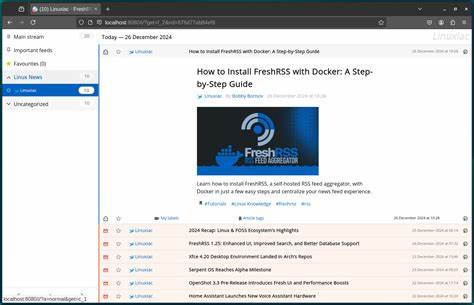

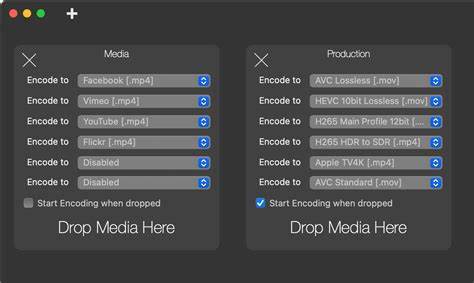

以增强现实为载体,结合大数据和人工智能技术,开发辅助判断工具仍有很大潜力。例如,利用图像识别技术提示用户注意某些明显的虚假广告,或通过实时事实核查帮助判别医药信息的真实性。此类辅助工具更像是增强认知的手段,而非取代人类判断。这样既保障用户的信息安全,又促进其辨别能力的发展。同时,技术发展也促使监管机构和社会组织加强对虚假信息和欺诈行为的治理。通过法律法规的完善以及公众教育的普及,降低虚假和有害信息对社会的影响,将为现实世界的信息安全构建坚实基础。

在智能设备不断普及的未来,人们能期望这些设备成为辅助保护的伙伴,但不能完全依赖技术替代个人的思考。增强现实中的安全警示是科技与人类智慧结合的产物,需要技术、伦理、法规和社会教育多方面的共同努力。综上所述,现实世界没有像数字世界那样成熟的恶意软件检测系统,主要由于信息复杂性、人类自主判断需求、隐私与安全挑战、技术瓶颈及文化差异等多重因素限制。未来随着技术进步和社会体系完善,基于增强现实的辅助检测工具有望成为现实,帮助人们更好地辨别风险信息,提升现实世界的安全水平。然而,技术绝非万能,依然要强调个人的独立思考和信息鉴别能力,这才是应对信息时代挑战的根本之道。