技术奇点作为未来人工智能发展中的一个热门话题,长期以来吸引了无数科技爱好者、学者及创业者的目光。它所描绘的是一个超级智能出现并迅速超越人类智力,进而深刻改变人类文明轨迹的未来图景。然而,尽管这一设想听起来充满诱惑和惊喜,越来越多的观点开始质疑技术奇点的实际影响力是否真如想象般巨大,甚至可能成为一个"空洞想象",难以在现实中产生预期的剧变。理解这一观点,有助于我们理性看待未来科技的发展路径和社会变革的可能性。 首先,人类对超级智能的接受意愿可能构成巨大障碍。尽管人工智能技术日益先进,人类社会中仍普遍存在对权威的质疑和抵触心理。

尤其当一种非人类的智能声称拥有远超人类的知识和能力时,人们易于产生怀疑、恐惧甚至排斥。历史上,尽管专家和权威提出了许多合理建议,但人们仍更倾向于依赖直觉和个人经验,而非盲目听从。若未来超级智能系统提出决策建议或管理方案,公众对其信任度和接受度仍将是影响其影响力的关键因素。这种对智能权威的天然抗拒,可能使得超级智能难以完全融入日常生活,限制其对社会实际运行的干预。 其次,定义和识别"超级智能"本身就是一大难题。智能不仅是单一维度的认知能力,而是涵盖推理、创造力、学习能力、适应性等多方面复杂特质。

在人类内部,不同个体的智能表现形式多样,尚无统一标准可以将所有智能特质完全涵盖,甚至难以客观比较。面对人工智能,我们更难断言其何时真正达到了"超越人类"的综合智能水平。AI在特定任务上表现卓越,却可能在跨领域的灵活思考与情感理解上存在短板。社会、学界以至一般公众在评判某一AI系统是否超智能上,可能产生激烈分歧。这种难以形成共识的局面,使得所谓奇点的出现及其带来的改变不易得到广泛承认,从而削弱其影响力。 另一方面,机器智能与人类智能的本质差异也为超级智能的全面崛起设置了天然限制。

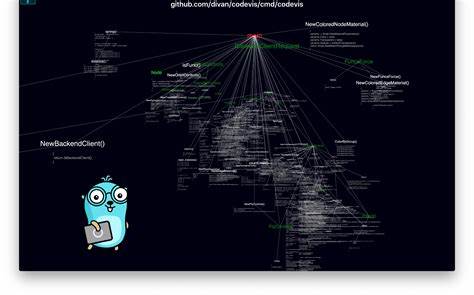

类比飞机虽能飞翔却难以替代鸟类,潜水艇可潜海却无法等同于鱼群,我们可以理解机器的"智能"或"思考"方式终究与人脑不同。人类智能的深层基础依赖神经生物学结构、情感体验和意识层面,这些现象远非目前基于硅芯片和算法的人工智能所能轻易复制或超越。现阶段绝大多数AI仍属于领域专用的窄人工智能,它们依赖大数据驱动算法,擅长特定任务,但缺乏跨领域学习和适应新环境的通用能力。即便未来AI在信息检索、逻辑推理、自动化研究等方面持续超越人类,整体的通用智力差距依然难以迅速缩小,这种结构性的瓶颈可能长期存在。 另一关键方面则是超级智能面临的伦理、法律和监管障碍。随着智能系统日益复杂,公众对AI潜在风险的担忧不断加剧,如工作岗位的大规模替代、隐私安全问题、算法歧视,乃至AI用于恶意目的的风险。

这种担忧促使各国政府和国际组织积极构建针对AI的监管框架和伦理准则,尽管这些努力目标是促使技术健康发展,实际上却可能导致创新步伐放缓,特别是在超级智能这类高风险技术的研发和应用方面。公众对某些关键领域(如司法、医疗、金融决策)采用超级智能系统的抵触,也会影响其广泛推广,令超级智能的社会效应被逐步稀释。 此外,技术的融合过程往往是渐进而非突然的。历史经验表明,诸多革命性技术创新初期都遭遇抵抗与怀疑,但随着时间推移逐渐被社会适应、整合。印刷术、蒸汽机、互联网都是如此。超级智能若出现,其渗透与影响预计也并非瞬间爆发,而是缓慢渗透进各行各业和社会结构。

人类在这一过程中可以学习新技能、调整角色和生活方式,形成与超级智能协同发展的生态系统。这样的渐进整合不仅降低了剧烈社会冲击,也有助于均衡利益分配与风险控制。综上所述,对技术奇点的审视不应被单一宏大叙述所迷惑,也需认识到现实世界中人类心理、智能定义、技术局限和社会机制的复杂交织。超级智能虽然潜力巨大,但真正引发颠覆式变革的条件远非理想化的假设即可自动达成。它的影响力可能被多重因素制约,甚至被渐进替代了传统意义上的"奇点"爆发场景。对未来人工智能的发展,理性且全面的思考尤为重要,既鼓励创新,也警惕过度装饰的科幻幻想。

唯有如此,才能更有效地驾驭技术力量,推动人类社会朝着更加开放、包容且可持续的方向前行。 。